少年时,曾研习 Geographic Information System,可惜学无所成,侥幸毕业。成年后,误打误撞进入传媒圈子,先后在印刷、电子、网络媒体打滚,略有小成。中年后,修毕信息科技硕士,眼界渐扩,决意投身初创企业,窥探不同科技领域。近年,积极钻研数据分析与数码策略,又涉足 Location Intelligence 开发项目;有时还会抽空执教鞭,既可向他人分享所学,亦可鞭策自己保持终身学习。

在生成式AI世代下,最抢手的硬件产品是英伟达(NVIDIA)出品的图像处理器(GPU),在全球AI加速器的市占率高达80%至95%,让该公司跃居为AI芯片龙头。AMD、Intel两大处理器生产商拼命追赶英伟达,但却难见其尾灯,于是联同微软、Google、Meta等合共8大科技巨头,组建AI技术联盟“Ultra Accelerator Link”,试图与之抗衡。究竟这个巨大联盟能否动摇NVIDIA的AI霸业呢?

排除NVIDIA的AI产业联盟

2024年4月,微软(Microsoft)、Meta、超威(AMD)、博通(Broadcom)宣布结盟,成建立一个新的AI产业小组“Ultra Accelerator Link”(UALink),以开发GPU连结技术的新标准。5月,UALink建立一个名为“UALink Promoter Group”的推广小组,同时再有新成员加入,包括:Google、英特尔(Intel)、思科(Cisco)、惠普(HP)。但有趣的是,这个AI产业小组始终将AI芯片龙头NVIDIA排除在外。

国际市调机构Gartner评估,2024年用于AI服务器中的GPU市场可望达到210亿美元(约1,638亿港元),及至2028年将攀升至330亿美元(约2,574亿港元),但预计当中80%至95%的份额都会由NVIDIA独占。微软、Google、Meta已购入数十亿美元的NVIDIA硬件,用于自身的AI模型与云端运算平台,但如今显然想减少对AI芯片龙头的过度依赖,于是决定采取合纵策略,联合不同厂商抗衡英伟达,形成8大科技巨头围攻英伟达之势。

GPU互连技术壁垒相对较低

事实上,NVIDIA之所以能建立有如堡垒般稳固的AI霸业,全赖有多重护城河在背后支撑。除广为人知的GPU硬件设计和《CUDA》开发软件平台外,英伟达还有第三条护城河——GPU高速互连技术“NVLink”。相比起GPU和《CUDA》,GPU与GPU之间高速连接的技术壁垒相对较低,加上相关产业变革正处于起步阶段,故此成为8大巨头突破NVIDIA堡垒的最佳切入点。

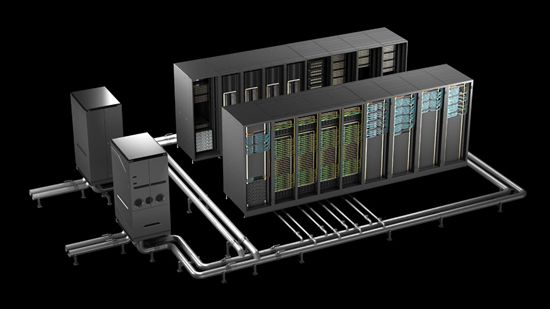

2024年3月,NVIDIA执行长黄仁勋在GTC大会上发表的最瞩目产品,当然是新一代Blackwell架构GPU,惟第五代NVLink也非常重要。它的双向总理论带宽从900GB/s倍增至1.8TB/s,足以让由36组GB200(一颗Grace CPU+两颗B200 GPU)组成的GB200 NVL72服务器,把72颗GPU当成单一巨大GPU执行运算,令AI模型的训练速度增加4倍,推论速度更提高30倍。

今年第三季推出UALink 1.0

冲着NVLink而来的全新互联技术UALink,能够提供精准而高速的低延迟通讯,不但可以让单一服务器内连接1,024颗GPU,而且容许GPU附加的内存之间进行直接加载和储存;借着为GPU之间的沟通建立一个通用协议,使GPU到GPU能够更有效地进行通讯,让AI业者可以更轻松地整合AI系统,并提高数据中心部署的灵活性与可扩展性。

UALink小组计划在2024年第三季成立一个“UALink联盟”(UALink Consortium),以监督UALink标准的开发进程。有别于NVLink只限运作于NVIDIA GPU之上,UALink属于开放标准,规格细节公开,让不同厂商自由读取、使用、实作,没有任何限制或授权问题。UALink 1.0版本将会同一时间推出,更高带宽的后继版本UALink 1.1则会在同年第四季推出。至于UALink的第一批产品,预估在“未来几年”便会上市。

Cerebras研发AI专用芯片

在Computex 2024的主题演讲上,AMD执行长苏姿丰赞扬UALink开放标准协议,强调标准开放方能促进AI产业创新,与NVIDIA叫战的意味甚浓。面对着UALink联盟的进逼,黄仁勋显得毫不畏惧。他老神在在地表示,该公司在7年前已着手研发NVLink,如今人们才开始意识到它的重要性:“我们的NVLink已经开发到第五代,而UALink只刚起步,等UALink第一代推出,NVLink可能到第七、八代了。”

苏姿丰认为,以以太网络技术为基础的UALink,才是扩大GPU运算规模的最佳解决之道。(图片来源:翻摄AMD官片YouTube影片)

NVIDIA执行长黄仁勋表示,NVLink能以令人难以置信的速度,连接起AI服务器内的GPU,形成一个巨大的GPU来执行运算。(图片来源:NVIDIA官网)

黄仁勋指出,在NVLink架构下,可以将8台GB200 NVL72服务器合组成“DGX SuperPOD”,把576颗B200 GPU当作是一颗超巨大GPU,提供11.5exaFLOPS的超级运算力。(图片来源:NVIDIA官网)

除科技巨头外,市场上也有不乏要挑战NVIDIA的初创公司。创立于2015年的美国加州初创Cerebras,埋首于研发比GPU更适用于训练AI模型的晶圆级芯片(WSE),被视为英伟达最强挑战者之一。踏入2024年,该公司已推出一款5奈米制程的WSE-3芯片,并开始跟戴尔(Dell)合作。Cerebras亦仿效NVIDIA,推出自家AI开发软件,可以搭配WSE芯片使用,惟功能暂时仍远逊于《CUDA》。

群雄并起争夺10%市场份额

虽然NVIDIA几近独占了整个AI芯片市场,又拥有多重护城河构成的无敌竞争优势,惟市场对寻求英伟达替代方案仍是兴趣满满。创投公司Thomvest Ventures董事总经理乌梅什·帕德瓦尔(Umesh Padval)直言:“客户喜欢看到市场领导者,但也期待有更多供货来源以供选择。”

作为Cerebras投资者之一的创投公司Eclipse Ventures认为,AI芯片市场规模日趋庞大,Cerebras等初创只要从NVIDIA手上抢到10%的市场份额,已是获利甚丰;但要留意的是,AMD与Intel也同样瞄准这10%份额。由是观之,未来AI芯片市场竞争格局可能会是:各大小企业拼命争夺这块10%的小片蛋糕;至于90%的大片蛋糕,则会被NVIDIA牢牢握在手中,短时间内仍未看到有谁可动其分毫!

《经济通》所刊的署名及/或不署名文章,相关内容属作者个人意见,并不代表《经济通》立场,《经济通》所扮演的角色是提供一个自由言论平台。

暂无读者评论!