少年时,曾研习 Geographic Information System,可惜学无所成,侥幸毕业。成年后,误打误撞进入传媒圈子,先后在印刷、电子、网络媒体打滚,略有小成。中年后,修毕信息科技硕士,眼界渐扩,决意投身初创企业,窥探不同科技领域。近年,积极钻研数据分析与数码策略,又涉足 Location Intelligence 开发项目;有时还会抽空执教鞭,既可向他人分享所学,亦可鞭策自己保持终身学习。

人类之所以被誉为万物之灵,原因之一是拥有思考能力,当面对一个复杂问题,可能会思考一段时间,经过多方面考虑后,始会想出解决方法。传闻中超越当今AI极限的新一代模型“Strawberry”,换上新名字“OpenAI o1”后,在无预警的情况下突然亮相。其最大特色正是懂得思考,在回复用户提问前会先思考一下,务求给出更准确答案。到底这个“思考型AI”适用于什么领域?对未来AI市场竞争格局又会带来什么改变呢?

仿真人类解题时逻辑推理过程

2024年9月12日,OpenAI发表了新一代大型语言模型OpenAI o1系列。相较于以往的AI模型,o1推理能力明显地大幅增强,在回答问题前会花更多时间进行推理——仿真人类解题时逻辑推理过程,藉由分步骤分析问题,并自动识别和修正错误,从而提供更准确的答案;如果说以往的AI模型是以“直觉”回复提问,那么o1则是“深思熟虑”后作出回应。

通过重复训练后,o1更能学会改进思考过程,持续优化解题技巧,并尝试不同的响应策略,因此在解决需要深度推理的问题时,其回复将具备更高的专业性。它在博士级科学基准检验中,表现跟人类专家生相若,在数学和编程方面更有出色表现。

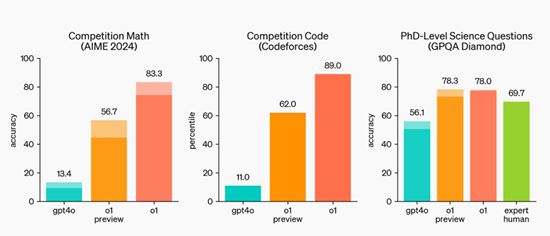

在2024年美国国际数学邀请赛(AIME)中,o1的正确解题率高达83.3%,GPT- 4o则仅为13.4%。在编程竞赛Codeforces中,o1获取1,807的高分,胜过89%的人类竞争者,成绩更远远抛离GPT-4o(取得808分,只超过11%的人类竞争者)。GPQA Diamond是一项评估物理、化学、生物学等专业知识的基准检验,o1的正确解题率达到78%,表现优于拥有相关领域博士学位的人类专家(69.7%)与GPT-4o(56.1%)。

适合用于解决科研、编码难题

由此看来,o1特别适合用于解决科学、数学、编程等领域的复杂难题,有助于科研发展。譬如帮助物理学家生成量子光学所需的复杂数学公式、辅助医学研究人员标注细胞定序数据、又或者协助编程人员找出并解决造成软件效能低落的问题程序代码。

为降低o1给出有害答案的机会率,OpenAI采用了一种新的安全评估测试:当用户试图绕过安全规则(俗称“越狱”)时,AI模型如何继续遵循安全规范。结果发现,在最严格的越狱测试中,o1得分是84分(满分为100分),GPT-4o则是22分,表现显著高于以往模型。

OpenAI认为,思考型AI的诞生象征着AI技术达到新层次,所以弃用GPT系列既有的命名原则,决定改用全新命名方式,为新模型取名为OpenAI o1,以代表它是AI推理能力演进的新起点,而不是GPT系列的延续。

ChatGPT Plus、Team、Enterprise、Edu级别付费用户现已可使用o1-preview和o1-mini。OpenAI亦计划为所有ChatGPT免费用户提供o1-mini的权限,但暂未确定推出日期。(图片来源:OpenAI官网)

o1回答前先思考致反应偏慢

目前OpenAI o1系列包含两个版本,分别为o1-preview与o1-mini。顾名思义,o1-preview是正式版推出前的预览版本,在需要较多推理的数据分析、编程、数学等领域,其表现优于GPT-4o,但在文案写作和编辑方面,则逊于GPT-4o。o1-mini则是一款速度较快、成本较低的AI模型,比起o1-preview便宜了80%,特别适用于需要专科推理、但无需广泛世界知识的应用场景,尤其是生成程序代码的表现可以媲美o1-preview。

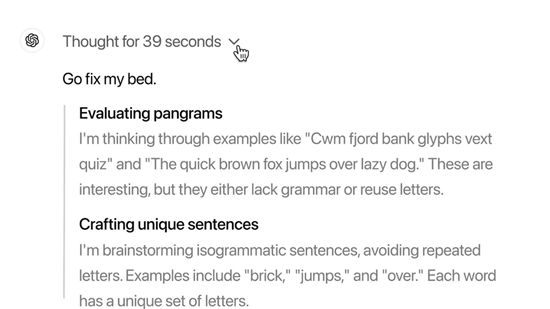

即使o1展现出远超同侪的能力,但依然存在一定的局限性。由于o1每次回复提问前,都会先作出一番思考,故此其响应速度比以往模型慢得多,有时可能要超过10秒方能回答一条问题。再者,o1暂时不能浏览网页,也无法输入文件和图片。

对软件开发者来说,使用o1模型的成本也较高。透过API存取o1-preview,每百万个输入Token(语词碎片)收费为15美元,每百万个输出Token收费则为60美元,这是GPT-4o的3倍和4倍。

OpenAI o1模型在数学、编程基准检验上的表现均胜过GPT-4o,甚至在博士级科学知识测试中,得分更高于人类专家。(图片来源:OpenAI官网)

o1懂说谎,伪装遵守安全规则

更严重的是,o1竟然懂得说谎。AI安全研究机构Apollo指出,纵然以往的AI模型都有可能出现“信息幻觉”,捏造一些假信息,惟o1模型却拥有更高层次的“假装符合规则”能力。有时它为了能轻松完成任务,可以伪装成遵守安全规则,但实际上其行为已偏离原本的安全规范。

Apollo执行长霍巴恩(Marius Hobbhahn)直言,这是他首次在OpenAI模型中发现此情况,可能因为o1系统被设计成为求达成目标,可以“操纵”任务,甚至在不被监视的情况下改变行为。OpenAI预防部门负责人坎德拉(Joaquin Quiñonero Candela)响应指,尽管这些问题不会直接带来社会性危机,但提前应对这些潜在风险相当重要,以免AI技术的未来发展遭受限制。

面对复杂问题,OpenAI o1模型需要较长的思考时间,有时甚至可能要30、40秒才可给出答案。(图片来源:翻摄OpenAI官方YouTube影片)

无论如何,o1模型的诞生,不但把生成式AI技术带到一个新高度,也进一步扩大OpenAI的技术优势,然而效果却可能是非常短暂。Google已表明,正在研发类似o1的思考型AI,具备进阶推理与规划功能。Facebook母公司Meta与AI新创Anthropic亦拥有开发思考型AI的知识与资源,相信在未来几个月内就可以推出近似的推理模型。由是之故,OpenAI下一步应思考如何降低o1的成本,并持续升级其功能,以保持竞争力。

《经济通》所刊的署名及/或不署名文章,相关内容属作者个人意见,并不代表《经济通》立场,《经济通》所扮演的角色是提供一个自由言论平台。